Διέρρευσαν στο Διαδίκτυο πάνω από 100.000 ψεύτικες φωτογραφίες γυμνών γυναικών

Διέρρευσαν στο Διαδίκτυο πάνω από 100.000 ψεύτικες φωτογραφίες γυμνών γυναικών

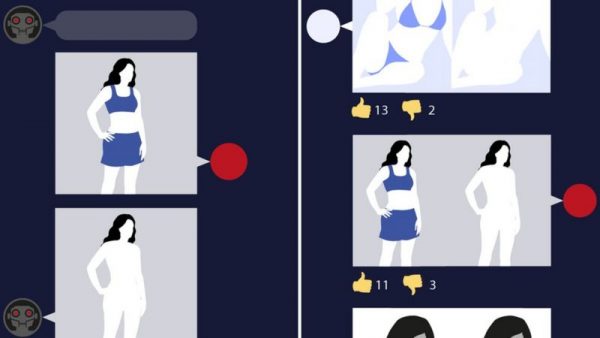

Ψεύτικες μεν, γυμνές δε εικόνες περισσότερων από 100.000 γυναικών που έχουν δημιουργηθεί από φωτογραφίες που αναρτώνται στα μέσα κοινωνικής δικτύωσης έχουν διαρρεύσει στο Διαδίκτυο, σύμφωνα με το BBC.

«Ένοχη» για το πρωτοφανές περιστατικό είναι η εφαρμογή ανταλλαγής μηνυμάτων Telegram που χρησιμοποιούσε AI (Artificial Intelligence) προκειμένου να «αφαιρεί» με ψηφιακό τρόπο τα ρούχα από φωτογραφίες αγνώστων γυναικών και κατόπιν να τις ανεβάζει στο ίντερνετ και να τις κάνει να φαίνονται ότι είναι γυμνές.

Και βάζουμε σε εισαγωγικά το «ένοχη», γιατί δεν φταίει η ίδια η εφαρμογή, αλλά κάποια bots (κρυφοί χρήστες) που έχουν ένα δικό τους κανάλι, μέσω του οποίου επεξεργάζονται τις επίμαχες φωτογραφίες.

Ο διευθύνων σύμβουλος της εταιρείας κυβερνοασφάλειας Sensity, Τζόρτζιο Πατρίνι, δήλωσε ότι η συγκεκριμένη τακτική χρήσης φωτογραφιών αγνώστων, τα λεγόμενα deepfakes, είναι «σχετικά νέα».

«Η ύπαρξη ενός απλού λογαριασμού κοινωνικών δικτύων με δημόσιες φωτογραφίες αρκεί για να γίνει ο καθένας από εμάς στόχος επιτήδειων», προειδοποίησε.

Το χειρότερο όλων δεν είναι αυτό όμως.

Το χειρότερο είναι ότι οι διαχειριστές του καναλιού από το οποίο διέρρευσαν οι φωτογραφίες… νίπτουν τας χείρας τους, μιλώντας για «απλή διασκέδαση».

«Κανείς δεν θέλει και ούτε πρόκειται να εκβιάσει καμία γυναίκα, αφού η ποιότητα της εικόνας δεν είναι ρεαλιστική», σημειώνει ο επικεφαλής του καναλιού, ονόματι «Ρ».

«Εκεί έξω υπάρχουν πόλεμοι, ασθένειες, πολλά κακά πράγματα που είναι επιβλαβή στον κόσμο», επισημαίνει, θεωρώντας ότι το κανάλι του δεν έκανε κάτι μεμπτό – αν και υποσχέθηκε να «κατεβάσει» όλες τις εικόνες που δημιουργήθηκαν με ΑΙ.

Tην αρχή αυτής της ιντερνετικής «μόδας» είχε κάνει πέρσι μια άλλη εφαρμογή, το DeepNude.

Υπήρχε σε δωρεάν έκδοση, με περιορισμένες δυνατότητες και ποιότητα, αλλά και σε έκδοση επί πληρωμή.

Αυτή η εκδοχή παρουσίαζε στη γωνία ένα σημάδι, το οποίο και μπορούσε να περικοπεί πανεύκολα, κάνοντας τη φωτογραφία να δείχνει εντελώς πραγματική.

Η εφαρμογή ωστόσο σταμάτησε από τους ίδιους τους δημιουργούς της, λιγότερο από μία ημέρα μετά την κυκλοφορία της.

Η ομάδα της DeepNude ανέφερε χαρακτηριστικά ότι «υποτίμησαν την επικινδυνότητα που έφερε η εφαρμογή και ότι θα μπορούσε να πάρει άσχημες διαστάσεις».

Αν και οι δημιουργοί, όταν ρωτήθηκαν, δήλωσαν ότι η DeepNude δεν ήταν κάτι ιδιαίτερο, η ανησυχία που δημιουργήθηκε γύρω από το όνομά της διαδιδόταν ταχύτατα.

Ο λόγος είναι ότι παρείχε τη δυνατότητα στιγμιαίας ψηφιακής επεξεργασίας φωτογραφιών, που ήταν πιθανό να ανήκουν σε ανυποψίαστες γυναίκες.

Στο παρελθόν, πολλοί άγνωστοι χρήστες-χάκερ έχουν επεξεργαστεί εικόνες γυναικών για να δημιουργήσουν βίντεο πορνογραφίας, χωρίς φυσικά τη συγκατάθεση του ατόμου που απεικόνιζαν.

Ο ίδιος ο δημιουργός της DeepNude δήλωσε ότι αργά ή γρήγορα κάποιος θα έφτιαχνε μια αντίστοιχη εφαρμογή, απλώς εκείνοι έτυχε να το κάνουν πρώτοι…

Ακολουθήστε το Protagon στο Google News